Med ankomsten av nye teknologier som dyp læring, AI og ML, er sky-GPUer etterspurt.

Hvis organisasjonen din arbeider med 3D-visualiseringer, maskinlæring (ML), kunstig intelligens (AI) eller tung databehandling av noe slag, betyr det mye hvordan du utfører GPU-beregning.

Tradisjonelt tok dyplæringsmodeller i organisasjoner mye tid for opplæring og beregningsoppgaver. Det pleide å drepe tiden deres, koste dem mye, og ga dem problemer med lagring og plass, noe som reduserte produktiviteten.

Den nye tidens GPU-er er designet for å løse dette problemet. De tilbyr høy effektivitet for å utføre tunge beregninger og raskere opplæring for AI-modellene dine parallelt.

I følge Indigo-undersøkelser kan GPU-er tilby 250 ganger raskere ytelse enn CPUer mens de trener nevrale nettverk assosiert med dyp læring.

Og med utviklingen av cloud computing, har vi sky-GPUer nå som transformerer verden av datavitenskap og andre nye teknologier ved å tilby enda raskere ytelse, enkelt vedlikehold, reduserte kostnader, rask skalering og sparing av tid.

Denne artikkelen vil introdusere deg til sky GPU-konsepter, hvordan det forholder seg til AI, ML, dyp læring og noen av de beste cloud GPU-plattformene du kan finne for å distribuere din foretrukne sky-GPU.

La oss begynne!

Innholdsfortegnelse

Hva er en Cloud GPU?

For å forstå en sky GPU, la oss først snakke om GPUer.

En Graphics Processing Unit (GPU) refererer til en spesialisert elektronisk krets som brukes til å endre og manipulere minne raskt for å akselerere å lage bilder eller grafikk.

Moderne GPUer tilbyr høyere effektivitet i manipulering av bildebehandling og datagrafikk på grunn av deres parallelle struktur enn Central Processing Units (CPUer). En GPU er innebygd på hovedkortet eller plassert på en PCs skjermkort eller CPU-matris.

Cloud Graphics Units (GPUer) er datamaskinforekomster med robust maskinvareakselerasjon som er nyttig for å kjøre applikasjoner for å håndtere massiv AI og dyp læringsarbeidsbelastning i skyen. Du trenger ikke å distribuere en fysisk GPU på enheten din.

Noen populære GPUer er NVIDIA, AMD, Radeon, GeForce og mer.

GPUer brukes i:

- Mobiltelefoner

- Spillkonsoller

- Arbeidsstasjoner

- Innebygde systemer

- Personlige datamaskiner

Hva brukes GPUer til:

Her er noen eksempler på bruk av GPUer:

- I AI og ML for bildegjenkjenning

- Beregninger for 3D datagrafikk og CAD-tegninger

- Teksturkartlegging og gjengivelse av polygoner

- Geometriske beregninger som translasjoner og rotasjoner av toppunkter til koordinatsystemer

- Støtter programmerbare shaders for å manipulere teksturer og hjørner

- GPU-akselerert videokoding, dekoding og strømming

- Grafikkrikt spill og skyspilling

- Storskala matematisk modellering, analyser og dyp læring som krever parallelle prosesseringsevner til generelle GPUer.

- Videoredigering, grafisk design og innholdsskaping

Hva er fordelene med Cloud GPUer? 👍

De viktigste fordelene ved å bruke Cloud GPUer er:

Svært skalerbar

Hvis du ønsker å utvide organisasjonen din, vil arbeidsmengden etter hvert øke. Du trenger en GPU som kan skaleres med økt arbeidsmengde. Cloud GPUer kan hjelpe deg med å gjøre det ved å la deg legge til flere GPUer enkelt uten problemer, slik at du kan møte økte arbeidsbelastninger. Omvendt, hvis du ønsker å skalere ned, er dette også raskt mulig.

Minimerer kostnadene

I stedet for å kjøpe fysiske GPUer med høy effekt som koster utrolig høyt, kan du gå med sky-GPUer til leie som er tilgjengelig til en lavere pris på timebasis. Du vil bli belastet for antall timer du har brukt sky-GPUene, i motsetning til de fysiske som ville ha kostet deg høyt selv om du ikke bruker dem mye.

Fjerner lokale ressurser

Cloud GPUer bruker ikke de lokale ressursene dine, i motsetning til fysiske GPUer som opptar en betydelig mengde plass på datamaskinen din. For ikke å nevne, hvis du kjører en storskala ML-modell eller gjengir en oppgave, bremser det datamaskinen.

Til dette kan du vurdere å sette ut beregningskraften til skyen uten å stresse datamaskinen og bruke den med letthet. Bare bruk datamaskinen til å kontrollere alt i stedet for å gi den alt presset til å håndtere arbeidsmengden og beregningsoppgaver.

Sparer tid

Cloud GPUer gir designere fleksibiliteten til rask iterasjon med raskere gjengivelsestider. Du kan spare mye tid ved å fullføre en oppgave på minutter som pleide å ta timer eller dager. Derfor vil teamets produktivitet øke betydelig, slik at du kan investere tid i innovasjon i stedet for gjengivelse eller beregninger.

Hvordan hjelper GPUer i dyp læring og AI?

Dyplæring er grunnlaget for kunstig intelligens. Det er en avansert ML-teknikk som legger vekt på representasjonslæring ved hjelp av kunstige nevrale nettverk (ANN). Den dype læringsmodellen brukes til å behandle store datasett eller svært beregningsmessige prosesser.

Så hvordan kommer GPUer inn i bildet?

GPUer er designet for å utføre parallelle beregninger eller flere beregninger samtidig. GPUer kan utnytte evnen til dyplæringsmodellen for å fremskynde store beregningsoppgaver.

Siden GPU-er har mange kjerner, tilbyr de utmerkede parallellbehandlingsberegninger. I tillegg har de høyere minnebåndbredde for å imøtekomme enorme mengder data for dyplæringssystemer. Derfor brukes de mye for å trene AI-modeller, gjengi CAD-modeller, spille grafikkrike videospill og mer.

Dessuten, hvis du vil eksperimentere med flere algoritmer samtidig, kan du kjøre flere GPUer separat. Det letter forskjellige prosesser på separate GPUer uten parallellitet. For dette kan du bruke flere GPUer på tvers av forskjellige fysiske maskiner eller i en enkelt maskin for å distribuere tunge datamodeller.

Hvordan du kan komme i gang med Cloud GPU

Å komme i gang med sky-GPUer er ikke rakettvitenskap. Faktisk er alt enkelt og raskt hvis du kan forstå det grunnleggende. Først av alt må du velge en sky GPU-leverandør, for eksempel Google Cloud Platform (GCP).

Deretter registrerer du deg for GCP. Her kan du benytte deg av alle standardfordelene som følger med, som skyfunksjoner, lagringsalternativer, databaseadministrasjon, integrasjon med applikasjoner og mer. Du kan også bruke deres Google Colboratory som fungerer som Jupyter Notebook for å bruke én GPU GRATIS. Til slutt kan du begynne å gjengi GPU-er for bruksområdet ditt.

Så la oss se på ulike alternativer du har for sky-GPUer for å håndtere AI og massive arbeidsbelastninger.

Linode

Linode tilbyr on-demand GPUer for parallelle prosesseringsarbeidsbelastninger som videobehandling, vitenskapelig databehandling, maskinlæring, AI og mer. Den gir GPU-optimaliserte VM-er akselerert av NVIDIA Quadro RTX 6000, Tensor, RT-kjerner, og utnytter CUDA-kraften til å utføre ray tracing-arbeidsbelastninger, dyp læring og kompleks prosessering.

Gjør kapitalutgiften din til driftskostnaden ved å ta tilgangen fra Linode GPU for å utnytte GPU-kraften og dra nytte av skyens reelle verdiforslag. I tillegg lar Linode deg konsentrere deg om kjernekompetansen i stedet for å bekymre deg for maskinvaren.

Linode GPUer eliminerer barrieren for å utnytte dem for komplekse brukstilfeller som videostreaming, AI og maskinlæring. I tillegg vil du få opptil 4 kort for hver forekomst, avhengig av hestekreftene du trenger for anslått arbeidsmengde.

Quadro RTX 6000 har 4 608 CUDA-kjerner, 576 Tensor-kjerner, 72 RT-kjerner, 24 GB GDDR6 GPU-minne, 84T RTX-OPS, 10 Giga Rays/sek Rays Cast, og FP32-ytelse på 16,3 TFLOPs.

Prisen for den dedikerte pluss RTX6000 GPU-planen er $1,5/time.

Paperspace CORE

Gjør organisasjonens arbeidsflyt forsterket med neste generasjons akselerert datainfrastruktur Paperspace CORE. Den tilbyr et brukervennlig og greit grensesnitt for å gi enkel onboarding, samarbeidsverktøy og skrivebordsapper for Mac, Linux og Windows. Bruk den til å kjøre applikasjoner med høy etterspørsel gjennom ubegrenset datakraft.

CORE gir et lynraskt nettverk, umiddelbar klargjøring, 3D-appstøtte og full API for programmatisk tilgang. Få en fullstendig oversikt over infrastrukturen din med et enkelt og intuitivt GUI på ett enkelt sted. I tillegg får du suveren kontroll med COREs administrasjonsgrensesnitt som har robuste verktøy og lar deg filtrere, sortere, koble til eller opprette maskiner, nettverk og brukere.

COREs kraftige administrasjonskonsoll utfører oppgaver raskt som å legge til Active Directory-integrasjon eller VPN. Du kan også administrere de komplekse nettverkskonfigurasjonene enkelt og fullføre ting raskere med noen få klikk.

Dessuten vil du finne mange integrasjoner som er valgfrie, men nyttige i arbeidet ditt. Få avanserte sikkerhetsfunksjoner, delte disker og mer med denne sky GPU-plattformen. Nyt de rimelige GPUene ved å få utdanningsrabatter, faktureringsvarsler, fakturert for et sekund osv.

Legg til enkelhet og hastighet til arbeidsflyten til en startpris på $0,07/time.

Google Cloud GPUer

Få høyytende GPUer for vitenskapelig databehandling, 3D-visualisering og maskinlæring med Google Cloud GPUer. Det kan bidra til å øke hastigheten på HPC, velge et bredt spekter av GPUer for å matche prispunkter og ytelse og minimere arbeidsmengden med maskintilpasninger og fleksible priser.

De tilbyr også mange GPUer som NVIDIA K80, P4, V100, A100, T4 og P100. I tillegg balanserer Google Cloud GPUer minnet, prosessoren, høyytelsesdisken og opptil 8 GPUer i hver forekomst for den individuelle arbeidsbelastningen.

Videre får du tilgang til bransjeledende nettverk, dataanalyse og lagring. GPU-enheter er bare tilgjengelige i bestemte soner i enkelte regioner. Prisen vil avhenge av regionen, GPUen du velger, og typen maskin. Du kan beregne prisen ved å definere kravene i Google Cloud Pricing Calculator.

Alternativt kan du gå for disse løsningene:

Elastisk GPU-tjeneste

Elastisk GPU-tjeneste (EGS) gir parallelle og kraftige databehandlingsmuligheter med GPU-teknologi. Den er ideell for mange scenarier som videobehandling, visualisering, vitenskapelig databehandling og dyp læring. EGS bruker flere GPUer som NVIDIA Tesla M40, NVIDIA Tesla V100, NVIDIA Tesla P4, NVIDIA Tesla P100 og AMD FirePro S7150.

Du vil få fordeler som online dyplæringstjenester og opplæring, innholdsidentifikasjon, bilde- og stemmegjenkjenning, HD-mediekoding, videokonferanser, reparasjon av kildefilm og 4K/8K HD live.

I tillegg får du alternativer som videogjengivelse, beregningsfinansiering, klimaprediksjon, kollisjonssimulering, genteknologi, ikke-lineær redigering, fjernundervisningsapplikasjoner og ingeniørdesign.

- GA1-forekomsten gir opptil 4 AMD FirePro S7150 GPUer, 160 GB minne og 56 vCPUer. Den inneholder 8192 kjerner og 32 GB GPU-minne som fungerer parallelt og leverer 15 TFLOPS med enkel presisjon og en TFLOPS med dobbel presisjon.

- GN4-forekomsten gir opptil 2 NVIDIA Tesla M40 GPUer, 96 GB minne og 56 vCPUer. Den inneholder 6000 kjerner og 24 GB GPU-minne som leverer 14 TFLOPS enkeltpresisjon. På samme måte vil du finne mange forekomster som GN5, GN5i og GN6.

- EGS støtter 25 Gbit/s og opptil 2 000 000 PPS nettverksbåndbredde internt for å gi maksimal nettverksytelse som kreves av beregningsnodene. Den har en høyhastighets lokal cache som er festet med SSD eller ultra cloud disker.

- Høyytende NVMe-stasjoner håndterer 230 000 IOPS med I/O-latens på 200 s og gir 1900 Mbit/s lesebåndbredde og 1100 Mbit/s skrivebåndbredde.

Du kan velge mellom ulike kjøpsalternativer basert på dine behov for å få ressursene og betale kun for det.

Azure N-serien

Azure N-serien av Azure Virtual Machines (VM-er) har GPU-funksjoner. GPU-er er ideelle for grafikk og datamaskinintensive arbeidsbelastninger, og hjelper brukere å ruste opp innovasjon gjennom ulike scenarier som dyp læring, prediktiv analyse og ekstern visualisering.

Ulike N-serier har separate tilbud for spesifikke arbeidsmengder.

- NC-serien fokuserer på høyytelses maskinlæring og dataarbeidsbelastninger. Den siste versjonen er NCsv3 som har NVIDIAs NVIDIAs Tesla V100 GPU.

- ND-serien fokuserer på slutnings- og treningsscenarier i utgangspunktet for dyp læring. Den bruker NVIDIA Tesla P40 GPUer. Den nyeste versjonen er NDv2 som har NVIDIA Tesla V100 GPUer.

- NV-serien fokuserer på ekstern visualisering og andre intensive applikasjonsbelastninger støttet av NVIDIA Tesla M60 GPU.

- VM-ene NC, NCsv3, ND og NCsv2 tilbyr InfiniBand-sammenkobling som muliggjør oppskalering av ytelse. Her vil du få fordelene som dyp læring, grafikkgjengivelse, videoredigering, spill, etc.

IBM Cloud

IBM Cloud gir deg fleksibilitet, kraft og mange GPU-alternativer. Siden GPU er den ekstra hjernekraften som en CPU mangler, hjelper IBM Cloud deg med å få direkte tilgang til det mer tilgjengelige utvalget av serveren for sømløs integrasjon med IBM Cloud-arkitekturen, applikasjonene og APIene sammen med et distribuert nettverk av datasentre globalt.

- Du vil få GPU-alternativer for barmetallserver som Intel Xeon 4210, NVIDIA T4 grafikkort, 20 kjerner, 32 GB RAM, 2,20 GHz og 20 TB båndbredde. På samme måte får du også alternativer for Intel Xeon 5218 og Intel Xeon 6248.

- For virtuelle servere får du AC1.8×60 som har åtte vCPU, 60 GB RAM, 1 x P100 GPU. Her får du også alternativene AC2.8×60 og AC2.8×60.

Få bare metall-server-GPU til en startpris på $819/måned og den virtuelle server-GPU til en startpris på $1,95/time.

AWS og NVIDIA

AWS og NVIDIA har samarbeidet for å levere kostnadseffektive, fleksible og kraftige GPU-baserte løsninger kontinuerlig. Den inkluderer NVIDIA GPU-drevne Amazon EC2-forekomster og tjenester som AWS IoT Greengrass som distribueres med NVIDIA Jetson Nano-moduler.

Brukere bruker AWS og NVIDIA for virtuelle arbeidsstasjoner, maskinlæring (ML), IoT-tjenester og høyytelses databehandling. Amazon EC2-forekomster hvor NVIDIA GPU-er er ansvarlige for å levere skalerbar ytelse. Bruk dessuten AWS IoT Greengrass for å utvide AWS-skytjenestene til NVIDIA-baserte edge-enheter.

NVIDIA A100 Tensor Core GPU-ene driver Amazon EC2 P4d-forekomster for å levere bransjeledende nettverk med lav latens og høy gjennomstrømning. På samme måte vil du finne mange andre forekomster for spesifikke scenarier som Amazon EC2 P3, Amazon EC2 G4, etc.

Søk om GRATIS prøveversjon og opplev kraften til GPU til kanten fra skyen.

OVHcloud

OVHcloud tilbyr skyservere som er designet for å behandle massive parallelle arbeidsbelastninger. GPUene har mange forekomster integrert med NVIDIA Tesla V100 grafiske prosessorer for å møte behov for dyp læring og maskinlæring.

De hjelper til med å akselerere databehandling innen grafisk databehandling, så vel som kunstig intelligens. OVH samarbeider med NVIDIA for å tilby den beste GPU-akselererte plattformen for høyytelses databehandling, AI og dyp læring.

Bruk den enkleste måten å distribuere og vedlikeholde GPU-akselererte beholdere gjennom en komplett katalog. Den leverer ett av fire kort til instansene direkte via PCI Passthrough uten noe virtualiseringslag for å dedikere alle kreftene til bruken din.

OVHclouds tjenester og infrastrukturer er ISO/IEC 27017, 27001, 27701 og 27018 sertifisert. Sertifiseringene indikerer at OVHcloud har et styringssystem for informasjonssikkerhet (ISMS) for å håndtere sårbarheter, implementere forretningskontinuitet, administrere risikoer og implementere et styringssystem for personverninformasjon (PIMS).

Dessuten har NVIDIA Tesla V100 mange verdifulle funksjoner som PCIe 32 GB/s, 16 GB HBM2 kapasitet, 900 GB/s båndbredde, dobbel presisjon-7 teraFLOPs, single precision-14 teraFLOPs og deep learning-112 teraFLOPs.

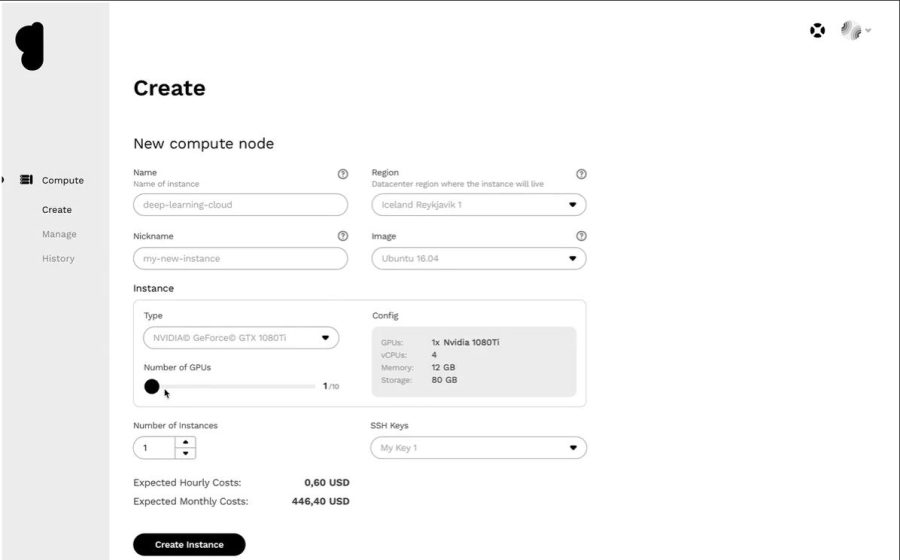

Lambda GPU

Tren dyp læring, ML og AI-modeller med Lambda GPU Cloud og skaler fra en maskin til det totale antallet VM-er i løpet av noen klikk. Få forhåndsinstallerte hovedrammeverk og den nyeste versjonen av lambda-stakken som inkluderer CUDA-drivere og rammeverk for dyp læring.

Få tilgang til det dedikerte Jupyter Notebook-utviklingsmiljøet for hver maskin raskt fra dashbordet. Bruk SSH direkte med en av SSH-tastene eller koble til via nettterminalen i skydashbordet for direkte tilgang.

Hver forekomst støtter maksimalt 10 Gbps med inter-node-båndbredde som muliggjør spredt trening med rammeverk som Horovod. Du kan også spare tid i modelloptimalisering ved å skalere til antall GPUer på enkelt eller mange forekomster.

Med Lambda GPU Cloud kan du til og med spare 50 % på databehandling, redusere TCO i skyen, og du vil aldri få flerårige forpliktelser. Bruk en enkelt RTX 6000 GPU med seks VCPUer, 46 GiB RAM, 658 GiB midlertidig lagring for bare $1,25/time. Velg blant mange forekomster i henhold til dine krav for å få en pris på forespørsel for din bruk.

Genesis Cloud

Få en effektiv sky GPU-plattform til en svært rimelig pris fra Genesis Cloud. De har tilgang til mange effektive datasentre over hele verden som de samarbeider med for å tilby et stort utvalg applikasjoner.

Alle tjenestene er sikre, skalerbare, robuste og automatiserte. Genesis Cloud gir ubegrenset GPU-beregningskraft for visuelle effekter, maskinlæring, transkoding eller lagring, Big Data-analyse og mange flere.

Genesis Cloud tilbyr mange rike funksjoner GRATIS som øyeblikksbilder for å lagre arbeidet ditt, sikkerhetsgrupper for nettverkstrafikken, lagringsvolumer for de store datasettene, FastAI, PyTorch, forhåndskonfigurerte bilder og en offentlig API for TensorFlow.

Den har NVIDIA og AMD GPUer av forskjellige typer. Tren videre det nevrale nettverket eller generer animerte filmer ved å utnytte kraften til GPU-databehandling. Datasentrene deres kjører med 100 % fornybar energi fra geotermiske kilder for å redusere karbonutslipp.

Prisene deres er 85 % lavere enn andre leverandører, da du betaler for trinn på minuttnivå. Du kan også spare mer med langsiktige og ugyldige rabatter.

Konklusjon 👩🏫

Cloud GPUer er designet for å tilby utrolig ytelse, hastighet, skalering, plass og bekvemmelighet. Vurder derfor å velge din foretrukne sky-GPU-plattform med ferdige muligheter for å akselerere dyplæringsmodellene dine og enkelt håndtere AI-arbeidsbelastninger.