Stemmeassistenter som Alexa, Google Assistant og Siri har kommet langt de siste årene. Men på tross av alle forbedringene deres, er det én ting som holder dem tilbake: De forstår deg ikke. De stoler for mye på spesifikke stemmekommandoer.

Innholdsfortegnelse

Talegjenkjenning er bare et magisk triks

Taleassistenter forstår deg ikke. Egentlig ikke i alle fall. Når du snakker med et Google Home eller Amazon Echo, konverterer det i hovedsak ordene dine til en tekststreng og sammenligner det med forventede kommandoer. Hvis den finner en eksakt match, følger den et sett med instruksjoner. Hvis den ikke gjør det, ser den etter et alternativ til hva den skal gjøre basert på hvilken informasjon den har, og hvis det ikke fungerer får du en feilmelding som «Beklager, men jeg vet ikke det .» Det er lite mer enn en slengen magi for å lure deg til å tro at den forstår.

Den kan ikke bruke kontekstuelle ledetråder for å gjøre den beste gjetningen, eller til og med bruke en forståelse av lignende emner for å informere sine beslutninger. Det er ikke vanskelig å snuble stemmeassistenter heller. Mens du kan spørre Alexa «Jobber du for NSA?» og få et svar hvis du spør «Er du i hemmelighet en del av NSA?» du får et «jeg vet ikke den»-svaret (i hvert fall når dette skrives).

Mennesker, som virkelig forstår tale, fungerer ikke slik. Tenk deg at du spør et menneske: «Hva er den klarvain på himmelen? Den som er buet og full av stripete farger som rød, oransje, gul og blå.» Til tross for at klarvain er et oppdiktet ord, kan personen du spurte sannsynligvis finne ut fra konteksten at du beskriver en regnbue.

Mens du kan argumentere for at et menneske konverterer tale til ideer, kan et menneske deretter bruke kunnskap og forståelse for å konkludere med et svar. Hvis du spør et menneske om de jobber i hemmelighet for NSA, vil de gi deg et ja eller nei svar, selv om det svaret er løgn. Et menneske ville ikke si «jeg kjenner ikke den» til et slikt spørsmål. At mennesker kan lyve er noe som kommer med ekte forståelse.

Stemmeassistenter kan ikke gå utover programmeringen

Stemmeassistenter er til syvende og sist begrenset til programmerte forventede parametere, og å vandre utenfor dem vil bryte prosessen. Det faktum viser når tredjepartsenheter kommer inn for å spille. Vanligvis er kommandoen for å samhandle med disse veldig uhåndterlig, og tilsvarer «be enhetsprodusenten om å kommandere et valgfritt argument.» Et eksakt eksempel vil være: «Be Whirlpool om å sette tørketrommelen på pause.» For et enda vanskeligere å huske eksempel Geneva Alexa ferdigheter kontrollerer noen GE-ovner. En bruker av ferdigheten må huske å «fortelle Geneva» ikke «fortelle GE» så resten av kommandoen. Og selv om du kan be den om å forvarme ovnen til 350 grader, kan du ikke følge opp med en forespørsel om å øke temperaturen med ytterligere 50 grader. Et menneske kan imidlertid følge disse forespørslene.

Amazon og Google har jobbet veldig hardt for å overvinne disse hindringene, og det viser. Der du en gang måtte følge sekvensen ovenfor for å kontrollere en smartlås, kan du nå si «lås inngangsdøren» i stedet. Alexa pleide å bli forvirret av «fortell meg en hundevits», men be om en i dag, og det vil fungere. De har lagt til variasjoner til kommandoene du bruker, men til syvende og sist må du fortsatt vite den riktige kommandoen å si. Du må bruke riktig syntaks, i riktig rekkefølge.

Og hvis du synes det høres mye ut som en kommandolinje, tar du ikke feil.

Stemmeassistenter er en fancy kommandolinje

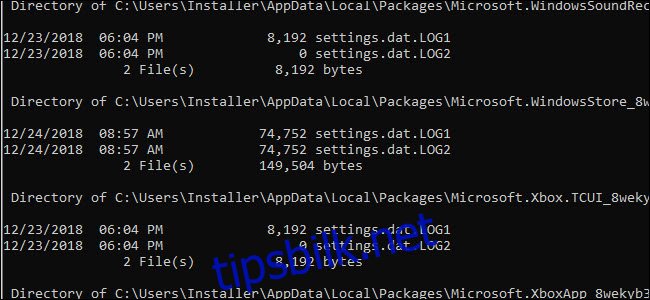

En kommandolinje er snevert definert for å utføre enkle oppgaver, men bare hvis du kjenner den riktige syntaksen. Hvis du går ut av den riktige syntaksen og skriver dyr i stedet for dir, vil ledeteksten gi deg en feilmelding. Du kan bruke aliaser for lettere å huske kommandoer, men du må ha en ide om hva de opprinnelige kommandoene var, hvordan de fungerer og hvordan du bruker aliaser effektivt. Hvis du ikke tar deg tid til å lære inn og ut av kommandolinjen, vil du aldri få mye ut av det.

Stemmeassistenter er ikke annerledes. Du må vite den riktige måten å si en kommando eller stille et spørsmål på. Og du må vite hvordan du setter opp grupper for Google og Alexa, hvorfor det er viktig å gruppere enhetene dine, og hvordan du navngir smartenhetene dine. Hvis du ikke følger disse nødvendige trinnene, vil du føle frustrasjonen ved å be stemmeassistenten din om å slå av studien bare for å bli spurt om «hvilken studie» bør slås av.

Selv når du bruker riktig syntaks i riktig rekkefølge, kan prosessen mislykkes. Enten med feil svar gitt eller et overraskende resultat. To Google Homes i samme hus kan gi vær for litt forskjellige steder selv om de har tilgang til samme brukerkontoinformasjon og internettforbindelse.

I eksemplet ovenfor gis kommandoen «Still en timer for en halv time». Google Home-huben opprettet en tidtaker kalt «Time» og spurte deretter hvor lang tidtakeren skulle være. Og likevel fungerte det riktig å gjenta den samme kommandoen tre andre ganger og skapte en 30-minutters timer. Å bruke kommandoen «Still inn en timer i 30 minutter» fungerer riktig på en mer konsistent basis.

Selv om det kan være mer flytende å snakke med Google Home eller Echo, fungerer stemmeassistenter og kommandolinjer på samme måte under panseret. Du trenger kanskje ikke å lære et nytt språk, men du må lære en ny dialekt.

Den snevre forståelsen av stemmeassistenter vil begrense veksten

Ingenting av dette hindrer stemmeassistenter som Google Assistant og Alexa i å fungere godt nok (selv om Cortana er en annen historie). Google Assistant og Alexa og søk anstendig på nettet etter spørsmål, men ikke overraskende er Google bedre på søk, og kan svare på grunnleggende spørsmål som målekonverteringer og enkel matematikk. Med et riktig oppsatt smarthus og godt trent bruker vil de fleste smarthuskommandoer fungere etter hensikten. Men dette kom gjennom arbeid og innsats, ikke intellektuell forståelse.

Tidtakere og alarmer pleide å være forenklede. Over tid ble navngivning lagt til, deretter muligheten til å legge til tid til en tidtaker. De gikk fra forenklet til mer komplisert. Taleassistenter kan svare på flere spørsmål, og hver dag bringer nye ferdigheter og funksjoner. Men det er ikke et produkt av selvvekst som kommer fra læring og forståelse.

Og ingenting av dette gir den iboende evnen til å bruke det som er kjent for å nå det ukjente. For hver kommando og spørsmål som fungerer, vil det alltid være tre som ikke gjør det. Uten et gjennombrudd innen AI som gir en menneskelignende evne til forståelse, er stemmeassistenter ikke assistenter i det hele tatt. De er bare talekommandolinjer – nyttige i riktig scenario, men begrenset til de scenariene de er programmert til å forstå.

Med andre ord: maskiner lærer ting, men kan ikke forstå dem.