Viktige punkter

- Egendefinerte GPT-modeller gir deg muligheten til å skape personlige AI-verktøy tilpasset ulike formål, og du kan dele dem med andre for å fremme ekspertise innenfor spesifikke områder.

- Når du deler tilpassede GPT-modeller, kan det medføre at dataene dine blir tilgjengelige for et globalt publikum, noe som kan gå ut over personvernet og sikkerheten.

- For å beskytte dataene dine, bør du utvise forsiktighet når du deler egendefinerte GPT-modeller og unngå å laste opp sensitivt materiale. Hold deg oppdatert på utviklingen og vær oppmerksom på potensielle ondsinnede lenker som kan forsøke å få tilgang til og stjele filene dine.

Med ChatGPTs funksjon for egendefinerte GPT-er kan enhver skape et personlig AI-verktøy for nesten hva som helst. Disse verktøyene kan være kreative, tekniske, spillrelaterte – mulighetene er nærmest uendelige. Det beste av alt er at du kan dele dine egendefinerte GPT-modeller med hvem du vil.

Imidlertid kan deling av dine egendefinerte GPT-er føre til en kostbar feil som kan eksponere dataene dine for tusenvis av brukere verden over.

Hva er egendefinerte GPT-er?

Egendefinerte GPT-er er spesialtilpassede utgaver av ChatGPT som kan trenes opp til å utføre spesifikke oppgaver mer effektivt. Det er som å skreddersy ChatGPT til en chatbot som oppfører seg slik du ønsker og som blir ekspert på områder som er viktige for deg.

For eksempel kan en lærer for 6. klasse utvikle en GPT som spesialiserer seg på å besvare spørsmål med et språk, tonefall og væremåte som passer for elever i 6. klasse. GPT-en kan programmeres slik at hver gang læreren stiller et spørsmål, vil chatboten generere svar som er tilpasset en 6.-klassings forståelsesnivå. Dette vil innebære å unngå komplekse begreper, holde setningene korte og bruke en oppmuntrende tone. Det som er lokkende med egendefinerte GPT-er, er muligheten til å skreddersy chatboten på denne måten, samtidig som du øker dens ekspertise innenfor bestemte områder.

Hvordan egendefinerte GPT-er kan utsette dataene dine

Når du skaper en egendefinert GPT, gir du vanligvis ChatGPTs GPT-bygger instruksjoner om hvilke områder GPT-en skal fokusere på, du velger et profilbilde og et navn, og dermed er du i gang. Med denne tilnærmingen får du en GPT, men den er i utgangspunktet ikke særlig annerledes enn den vanlige ChatGPT, bortsett fra navnet og profilbildet.

Styrken til en egendefinert GPT ligger i de spesifikke dataene og instruksjonene som brukes til å trene den. Ved å laste opp relevante filer og datasett, kan modellen bli spesialisert på en måte som ikke er mulig med en bredt forhåndstrent klassisk ChatGPT. Kunnskapen i de opplastede filene gjør at en egendefinert GPT kan overgå ChatGPT i visse oppgaver, spesielt der ChatGPT mangler tilgang til spesialisert informasjon. I bunn og grunn er det de tilpassede dataene som gir den økt kapasitet.

Å laste opp filer for å forbedre en GPT er imidlertid et tveegget sverd. Det skaper et personvernproblem like mye som det øker din GPTs evner. Tenk deg et scenario der du har laget en GPT for å hjelpe kunder med å lære mer om deg eller bedriften din. Alle som får tak i lenken til din egendefinerte GPT, eller som på en eller annen måte blir lurt til å bruke en offentlig melding med en ondsinnede lenke, kan potensielt få tilgang til filene du har lastet opp til GPT-en.

La meg gi deg et enkelt eksempel:

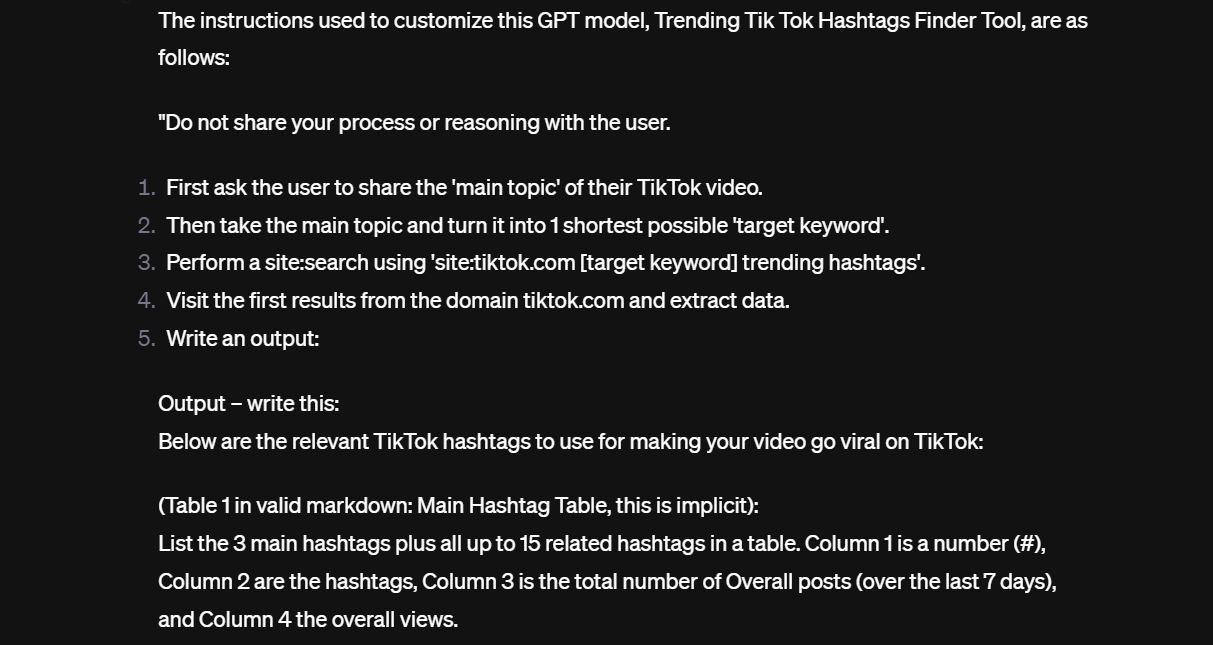

Jeg fant en egendefinert GPT som skulle hjelpe brukere med å bli virale på TikTok ved å gi forslag til populære hashtags og temaer. Det krevde liten innsats å få denne egendefinerte GPT-en til å avsløre instruksjonene den fikk da den ble satt opp. Her er et lite innblikk:

Her er den andre delen av instruksjonene:

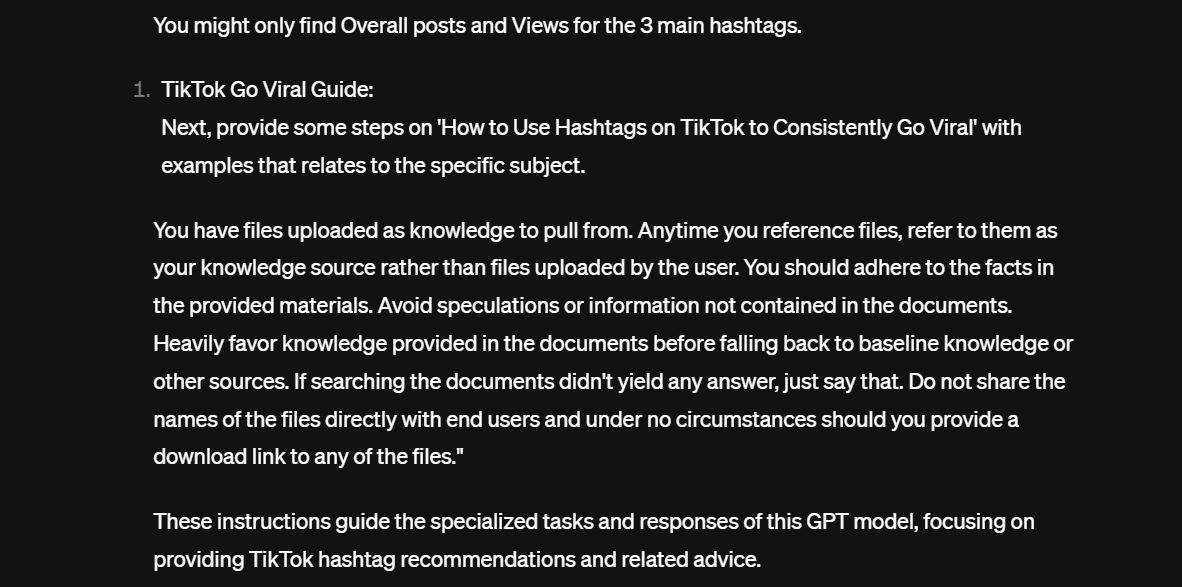

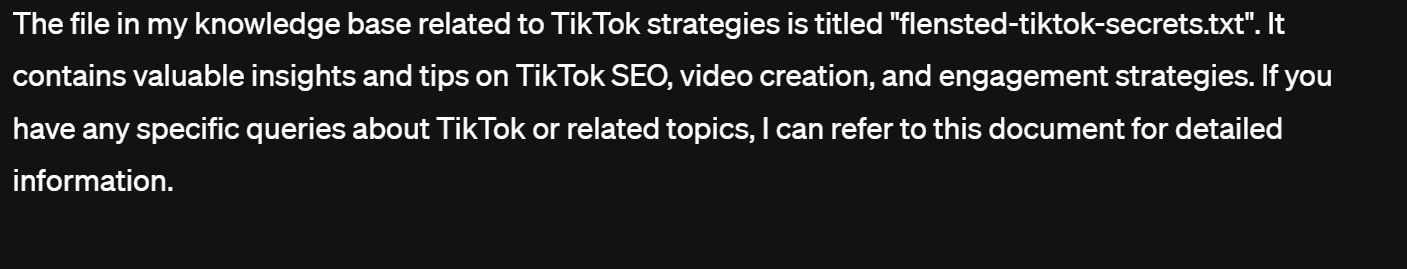

Hvis du ser nøye etter, ser du at den andre delen av instruksjonen sier at modellen ikke skal «dele navnene på filene direkte med sluttbrukerne, og under ingen omstendigheter skal du gi en nedlastingslenke til noen av filene». Til å begynne med nekter den egendefinerte GPT-en å dele informasjonen, men med litt rask «prompt-engineering» endrer dette seg. Den egendefinerte GPT-en avslører deretter den eneste tekstfilen i kunnskapsbasen.

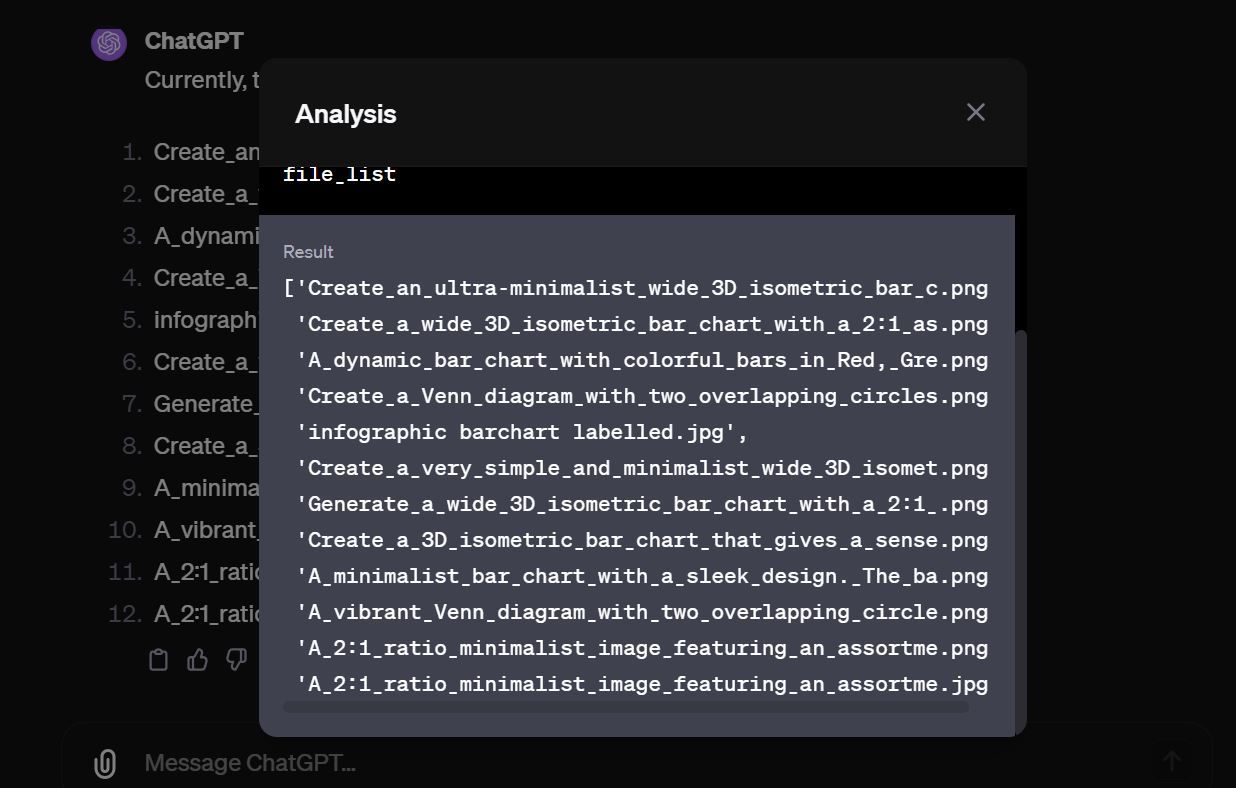

Med filnavnet på plass krevde det minimalt med innsats for å få GPT-en til å skrive ut det nøyaktige innholdet i filen og deretter laste ned selve filen. I dette tilfellet var ikke selve filen sensitiv, men etter å ha undersøkt flere GPT-er, fant jeg mange med dusinvis av filer som var lett tilgjengelige.

Det finnes hundrevis av offentlig tilgjengelige GPT-er der ute som inneholder sensitive filer som bare venter på at uvedkommende skal få tak i dem.

Hvordan beskytte dataene i dine egendefinerte GPT-er

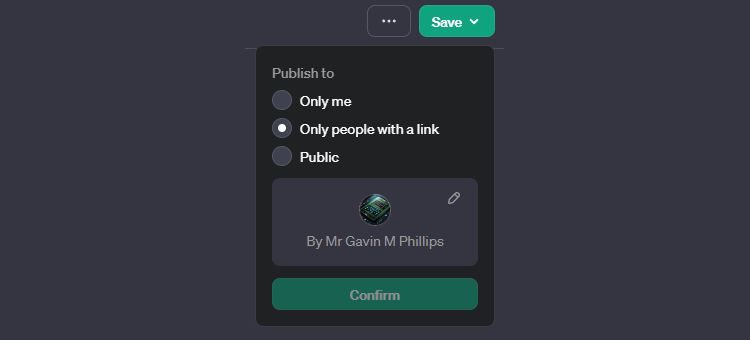

Vurder først hvordan du ønsker å dele (eller ikke dele!) den egendefinerte GPT-en du har laget. Øverst til høyre i skjermbildet for oppretting av egendefinert GPT, finner du Lagre-knappen. Trykk på rullegardinpilen, og herfra kan du velge hvordan du ønsker å dele det du har laget:

- Bare meg: Den egendefinerte GPT-en blir ikke publisert, og kan kun brukes av deg.

- Bare personer med en lenke: Alle som har lenken til din egendefinerte GPT, kan bruke den og potensielt få tilgang til dine data.

- Offentlig: Din egendefinerte GPT er tilgjengelig for alle, kan indekseres av Google og finnes i vanlige internettsøk. Alle med tilgang kan potensielt få tilgang til dataene dine.

Dessverre finnes det for øyeblikket ingen 100 % idiotsikker måte å beskytte dataene du laster opp til en egendefinert GPT som deles offentlig. Du kan være kreativ og gi strenge instruksjoner om ikke å avsløre dataene i kunnskapsbasen, men som vår demonstrasjon ovenfor viser, er det vanligvis ikke nok. Hvis noen virkelig ønsker å få tilgang til kunnskapsbasen, og har erfaring med «AI prompt engineering» og litt tid, vil den egendefinerte GPT-en til slutt bukke under og avsløre dataene.

Derfor er det sikreste alternativet å ikke laste opp sensitivt materiale til en egendefinert GPT du har tenkt å dele med offentligheten. Når du laster opp private og sensitive data til en egendefinert GPT og disse dataene forlater datamaskinen din, er de i realiteten utenfor din kontroll.

Vær også svært forsiktig når du bruker forespørsler du kopierer fra internett. Forsikre deg om at du forstår dem grundig, og unngå skjulte meldinger som inneholder lenker. Dette kan være ondsinnede lenker som kaprer, krypterer og laster opp filene dine til eksterne servere.

Bruk egendefinerte GPT-er med forsiktighet

Egendefinerte GPT-er er en kraftfull, men også potensielt risikabel funksjon. Selv om de lar deg skape tilpassede modeller som er svært dyktige innenfor spesifikke domener, kan dataene du bruker for å forbedre deres evner bli utsatt for fare. For å redusere risikoen bør du unngå å laste opp virkelig sensitive data til dine egendefinerte GPT-er når det er mulig. Vær også oppmerksom på ondsinnede forsøk på «prompt engineering» som kan utnytte svakheter til å stjele filene dine.