Vil du bygge dine egne generative AI-applikasjoner? Her er en liste over AI-modeller for å hjelpe deg i gang.

AI-modeller er nevrale nettverksarkitekturer som yter ekstremt godt på spesifikke oppgaver. Disse inkluderer konvolusjonelle nevrale nettverksarkitekturer for bildeklassifisering og segmentering, generative forhåndstrente store språkmodeller, diffusjonsmodeller for bildegenereringsoppgaver, og

Nylig har AI-modeller for generative AI-applikasjoner – for bilder, tale, tekst og mer – blitt superpopulære. Noe som både skyldes fremskritt innen forskning og tilgang til databehandling med høy ytelse.

Her er en rask oppsummering av de populære AI-modellene jeg skal diskutere nedenfor.

ModelKey-funksjonerGPT-4En stor språkmodell med åpen kildekode kan brukes til å bygge LLM-drevne applikasjonerLLaMAEn rekke NLP-applikasjoner, fra chatbots til kodeassistenterFalkStor språkmodell med åpen kildekode kan brukes til å bygge LLM-drevne applikasjonerStabil diffusjonTekst-til-bilde, bildemaling, utmaling og oppskaleringDALL-E 2Tekst-til-bilde genereringHviskeTalegjenkjenning, språkoversettelse og språkgjenkjenningStableLMÅpen kildekode lett, stor språkmodellKLIPPEn rekke NLP-oppgaver, som svar på spørsmål, oppsummering og tekstgenereringInternLMEn åpen kildekode stor språkmodell; kan brukes til å bygge LLM-drevne applikasjonerSegmenter hva som helst modellZero-shot generalisering for en rekke bildesegmenteringsoppgaverWaveGANLydgenereringCycleGAN og pix2pixBilde-til-bilde oversettelseBioGPTBiomedisinsk tekstgenerering og gruvedrift

Fra AI-kunst til å bygge en personlig kodeassistent, du kan bygge en rekke generative AI-applikasjoner basert på dine interesser. Her viser vi noen interessante AI-modeller du kan utforske – sammen med nøkkelfunksjonene deres.

La oss komme i gang!

Innholdsfortegnelse

GPT-4

Fra å generere reiseruten for dine kommende reiseplaner til å utarbeide følgebrev som passer til stillingsbeskrivelsen, har ChatGPT blitt en del av våre daglige oppgaver. GPT-4dens etterfølger, er en enda kraftigere stor språkmodell.

Det er OpenAIs kraftigste AI-system med bedre resonneringsevner og ytelse enn ChatGPT.

Her er en teknisk snakk om hvordan GPT-4 fungerer og hvordan du kan bygge applikasjoner med den.

Du kan få tilgang til ChatGPT-grensesnittet med en gratis OpenAI-konto. For å få tilgang til GPT-4 bør du imidlertid ha et ChatGPT Plus-abonnement.

Her er noen applikasjoner du kan bygge med disse store språkmodellene:

- Egendefinerte chatbots

- Forbedre CRM-plattformer

- Spørsmålsbesvarelse på tilpasset korpus

- Andre oppgaver som oppsummering og tekstgenerering

Deretter skal vi gå over noen store språkmodeller med åpen kildekode.

LLaMA

Meta AI utgitt LLaMA, en grunnleggende stor språkmodell med 65B parametere, i februar 2023. Deretter ble LLama 2 utgitt med betydelige forbedringer i forhold til forrige utgivelse. Du får tilgang til følgende:

- Llama Chat: Finjustert Llama 2

- Code Llama: Bygget på Llama 2; trent på over 500B tokens med kode; støtter kodegenerering i alle de mest populære programmeringsspråkene

Du kan laste ned og bruke Llama-modellene ved å ber om tilgang. Sjekk ut denne opplæringen for å lære hvordan du bruker LLama 2 i Python-applikasjonene dine:

Falk

Falk er nok en åpen kildekode-språkmodell av Technology Innovation Institute (UAE). Alle modellene i Falcon LLM-pakken er åpen kildekode og er tilgjengelig for åpen tilgang. Så du kan bruke dem til å bygge LLM-drevne applikasjoner.

For øyeblikket er det fire modellstørrelser: 1.3B, 7.5B, 40B og 180B. for å yte bedre enn på flere benchmarks ble 180B-modellen trent på et datasett med 3.5T-tokens. Falcon LLM presterer på nivå med andre ledende åpen kildekode LLM-er.

Falcon 180B åpen kildekode LLM oppnår ytelse nær den til GPT-4. Sjekk ut denne opplæringen som dekker Falcon 180B, hvordan du kan bruke den, maskinvarekravene og hvordan du sammenligner med GPT-4:

Stabil diffusjon

Stabil diffusjon en tekst-til-bilde-modell for bildegenerering og andre kreative AI-applikasjoner. Den kan også brukes til bildeoppskalering og maling.

Stabil diffusjon XLutgitt i juli 2023, tilbyr flere forbedringer, inkludert:

- generere beskrivende bilder fra mye kortere spørsmål

- muligheten til å generere støttetekst i bilder

- bildemaling og utmalingsoppgaver

- samhandle med et hentet bilde for å generere varianter

Hvis du vil lære hvordan diffusjonsmodeller fungerer – metoden bak magien – sjekk ut Hvordan diffusjonsmodeller fungereret gratis kurs av DeepLearning.AI.

DALL-E 2

DALL-E 2 fra Open AI er en annen populær tekst-til-bilde-generasjonsmodell. Du kan bruke den til å generere realistiske bilder og kunst fra tekst – beskrivelse av naturlig språk.

Den kan brukes til følgende oppgaver:

- bildegenerering fra tekstmeldinger

- bildemaling og utmaling

- generere variasjoner av et bilde

Du kan få tilgang til DALL-E 2 via OpenAI API eller OpenAI labs webgrensesnitt.

Hviske

Åpne AI-er Hviske er en talegjenkjenningsmodell som kan brukes til en rekke applikasjoner, inkludert:

- språkidentifikasjon

- talegjenkjenningsoppgaver som transkripsjon av lydfiler

- taleoversettelse

Her er en veiledning om hvordan du konverterer tale til tekst ved hjelp av OpenAI Whisper API:

For å prøve ut modellen kan du installere whisper (openai-whisper) ved å bruke pip og få tilgang til API fra et Python-skript for å transkribere lydfiler. Videre kan du bruke andre store språkmodeller for å oppsummere transkripsjonen og bygge en lydfil → sammendragspipeline.

StableLM

StableLM er en åpen kildekode LLM-suite fra Stability AI. Parameterne 3B og 7B er tilgjengelige for øyeblikket. Påfølgende utgivelser vil inkludere større modeller med 15B – 65B parametere.

Så hvis du vil eksperimentere med lette LLM-er med åpen kildekode i applikasjonene dine, kan du prøve StableLM.

KLIPP

KLIPP står for Contrastive Language-Image Pre-training. Det er et nevralt nettverk, en multimodal modell, trent på et stort datasett av (tekst, bilde) par. Modellen utnytter naturlige språkdata, prøver å lære – fra de naturlige språkbeskrivelsene – bildenes semantikk. CLIP-modellen er i stand til å forutsi den mest relevante teksten gitt et bilde.

Med CLIP kan du utføre nullbildeklassifisering – uten kostbar forhåndstrening og finjustering. Videre kan du utnytte mulighetene til CLIP og vektordatabaser for å bygge interessante applikasjoner i:

- tekst-til-bilde og bilde-til-bilde-søk

- omvendt bildesøk

Segmenter hva som helst modell

Bildesegmentering er oppgaven med å identifisere piksler som tilhører et spesifikt objekt i et bilde. Meta AI utgitt Segment Anything Model (SAM) som kan brukes til å segmentere et hvilket som helst bilde og kutte ut objekter fra dem.

Bildekilde: Segmenter hva som helst

Bildekilde: Segmenter hva som helst

Du kan bruke ledetekster til å spesifisere hva som skal segmenteres i et bilde. SAM støtter for øyeblikket følgende ledetekster: grensefelt, masker og forgrunns- og bakgrunnspunkter. Modellen har også utmerket null-shot generaliseringsytelse på tidligere usett bilder. Så det kreves ingen eksplisitt opplæring.

Prøv ut SAM-modell i nettleseren din!

InternLM

InternLM er en språkmodell med åpen kildekode. Du kan prøve ut 7B-basismodellen og chat-modellen med åpen kildekode. Modellen støtter et kontekstvindu på 8K. I tillegg støtter InternLM kodetolker og funksjonsanropsmuligheter.

InternLM er også tilgjengelig i HuggingFace-transformatorbiblioteket. Du kan utnytte det lette rammeverket før trening. Den støtter også bygging og distribusjon av applikasjoner ved hjelp av LMDeploy. Så du kan bygge ende-til-ende generative NLP-applikasjoner med InternLM.

WaveGAN

WaveGAN er en modell for lydgenerering. Det hjelper å syntetisere rålyd fra prøver av ekte lyddata.

Du kan trene WaveGAN på et datasett med vilkårlige lydfiler og syntetisere lyd uten omfattende forhåndsbehandling.

CycleGAN og Pix2Pix

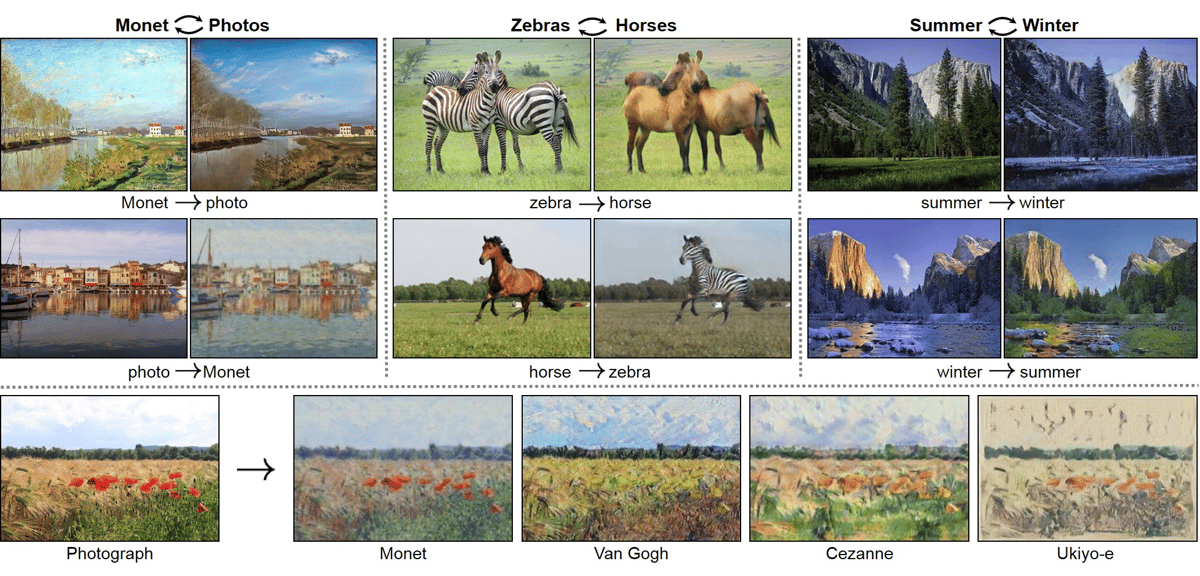

Så langt har vi dekket tale-til-tekst, tekst-til-bilde og andre modeller for ulike naturlig språkbehandlingsoppgaver. Men hva om du vil utføre bilde-til-bilde-oversettelse? Her kan du bruke CycleGAN for å lære en tilordning fra kildedomenet til måldomenet for å utføre bilde-til-bilde-oversettelse.

For eksempel, gitt bildet av en innsjø om vinteren, kan det være lurt å oversette det samme bildet når sesongen er sommer. På bildet av en hest kan det være lurt å erstatte hesten med en sebra mens du beholder samme bakgrunn. CycleGAN er godt egnet for slike oppgaver.

pix2pix-modellen kan brukes for bilde-til-bilde oversettelse; nøkkelfunksjonene til modellen inkluderer:

- rekonstruere objekter fra kantkart og

- fargelegge bilder

Du kan finne PyTorch-implementeringene av CycleGAN og pix2pix på GitHub.

BioGPT

BioGPT fra Microsoft er en transformatormodell du kan bruke for biomedisinsk datautvinning og tekstgenereringsapplikasjoner. Den bruker sekvens-til-sekvens-modellimplementeringene levert av fairseq.

Fairseq fra Facebook research (nå Meta AI) er et verktøysett som gir implementeringer av sekvens-til-sekvens-modeller for oppgaver som:

- språkmodellering

- oversettelse

- oppsummering

Begge forhåndstrente modeller og finjusterte modellsjekkpunkter er tilgjengelige. Du kan laste ned modellen enten fra URL-en eller fra HuggingFace-huben.

BioGPT-modellene er også en del av HuggingFace-transformatorbiblioteket. Så hvis du jobber i det biomedisinske området, kan du bruke BioGPT til å bygge domenespesifikke applikasjoner.

Innpakning

Jeg håper du fant noen nyttige modeller som du kan bygge generative AI-applikasjoner med. Selv om denne listen ikke er uttømmende, har vi dekket noen av de mest populære modellene du kan bruke til å bygge apper for tekst- og lydgenerering, tale-til-tekst-transkripsjon, bildesøk og mer.

Når du bygger applikasjoner ved hjelp av store språkmodeller, bør du være klar over de vanlige fallgruvene, som faktisk feil informasjon og hallusinasjoner. Og du kan møte begrensninger når du finjusterer modeller, da finjusteringsprosessen ofte er ressurskrevende.

Så hvis du er en utvikler, er det på tide å bli med i AI-revolusjonen og begynne å bygge interessante AI-applikasjoner! Du kan prøve ut disse modellene i Google Colab eller andre samarbeidsbaserte notatbøker for datavitenskap.